IBM在分布式深度学习取得巨大飞跃,效率提升狂甩谷歌、微软!

时间:2017-08-09 来源:互联网 浏览量:

IBM宣布进一步增强其PowerAI软件平台,旨在促进AI模型在目前最快的GPU上的实际扩展。IBM利用新的分布式深度学习(DLL)库扩展到256个GPU,IBM报告表示,打破了之前由Google和Facebook在两个著名的图像识别工作负载上所创造的记录。

Moor Insights&Strategy总裁兼首席分析师Patrick Moorhead表示:“这是过去六个月来所有深入学习行业公告中所见的最大突破之一。 “有趣的是,它来自IBM,而不是像Google这样的互联网巨头,这意味着企业可以使用OpenPower硬件和PowerAI软件,甚至通过云提供商Nimbix进行首次使用。”

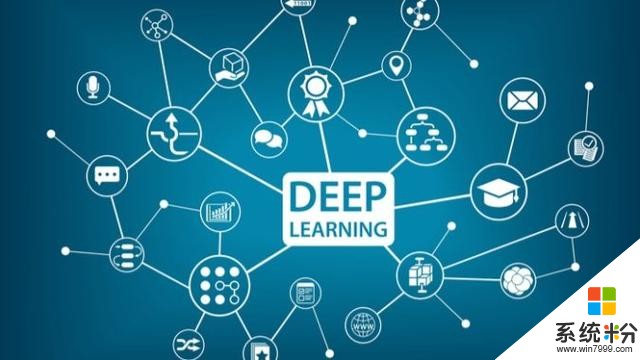

该公告的核心是由IBM Research科学家开发的一种新的通信算法,并封装为通信库,称为PowerAI DDL。作为PowerAI 4.0版本一部分的Power用户,现在可以使用库和API作为技术预览。改进多节点通信的其他努力往往只集中在一个单一的深度学习框架上,因此值得注意的是,PowerAI DDL被集成到多个框架中。目前,TensorFlow,Caffe和Torch计划添加对Chainer的支持。

没有使用Power系统的用户可以通过Nimbix Power Cloud访问新的PowerAI软件。

Nimbix首席执行官史蒂夫·希伯特(Steve Hebert)说:“像超级计算机和大型企业一样,Nimbix一直在努力将分布式能力建立在深入的学习框架中,而正如IBM公布的那样,事实证明这是一个完整的多框架的软件解决方案。

“这是真正的HPC技术,”他继续说。 “它采用传统HPC的一些最好的软件组件,并与AI和深度学习结合,以便能够提供该解决方案。我们的平台非常适合在HPC意义上进行扩展,对于能够对问题大小进行线性缩放的代码,它的延迟非常低。这意味着深入学习首次开始解决企业级的深度学习问题。使之成为可用于任何公司或消费者的大型超级计算机,而不是只有谷歌,百度这样的互联网企业,从而普惠于民。

DDL中的多环通信算法(参见IBM研究论文),提供延迟和带宽之间的良好折衷,并适应各种网络配置。完整的方法是专有的,但本文的第4部分提供了相当详细的库和算法的描述。

目前的PowerAI DDL实现基于Spectrum MPI。研究人员指出,MPI提供了许多需要的设施,从调度流程到基本的通信原语,在便携式,高效和成熟的软件生态系统中,研究人员提到,“如果需要,可以在没有MPI的情况下实现核心API”。

为了评估其新的PowerAI分布式深度学习库的性能,IBM使用64台IBM“Minsky”Power8 SL822LC服务器的集群进行了两次实验,每台服务器配备了通过Nvidia的高速NVLink互连连接的四个Nvidia Tesla P100 GPU。系统占用四个机架(每个16个节点),通过InfiniBand连接。

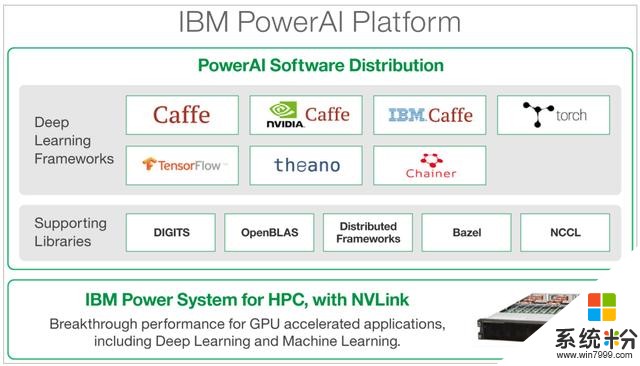

IBM报告说,其Power硬件和软件的组合为使用Caffe的Resnet-50神经网络提供了比Facebook最近通过Caffe2深度学习软件实现的更好的通信开销。DDL软件使用Caffe在其256-GPU Minsky集群上实现了95%的效率,而Facebook使用Caffe2框架在256个NVIDIA P100 GPU加速的DGX-1集群上实现了89%的扩展效率。可能影响比较的实施差异,例如Caffe与Caffe2,将在IBM Research论文中讨论。

使用Caffe与PowerAI DLL缩放结果,以使用总共256个Nvidia P100 GPU的64个Power8服务器上的ImageNet-1K数据集训练ResNet-50模型(来源:IBM)

在第二次基准测试中,IBM针对在非常大的数据集上训练的Resnet-101神经网络(750万图像,部分ImageNet-22k集)报告了新的图像识别精度为33.8%。微软在2014年发布的以前的记录显示了29.8%的准确性。

IBM研究员Hillery Hunter观察到,相比过去典型改进不到1%,准确度提高了4%,这是一个巨大的飞跃。

此外,借助IBM的分布式深度学习方法,ResNet-101神经网络模型在短短七个小时内进行了培训,相比之下,微软花了10天的时间来训练同一模型。IBM报告提到缩放效率为88%。

IBM认知系统业务部门的AI和HPC副总裁Sumit Gupta认为,提高速度和准确性将对企业客户带来巨大的利益。他说:“如果训练一个AI模型需要16天的时间,那么这个挑战的一部分就是不实际的。” 当你在一家大型企业工作时,只能拥有一些数据科学家,而你真的需要使其具有生产力,从而将16天降至7小时,从而使数据科学家的工作效率更高。”

某些应用程序特别受到时间限制。市场分析师Rob Enderle说:“在安全,军事,欺诈保护和自动驾驶中,你经常只需要几分钟或几秒的时间来训练系统来应对新的漏洞或问题,但目前通常需要几天时间。这有效地减少了几天到几个小时,并提供了一个潜在的路线图,以达到几分钟甚至几秒钟。像这样的场景让购买Power Systems来加速深入学习更容易。”

用例方面。推荐引擎,信用卡欺诈检测,抵押分析,零售客户的加售/交叉销售,购物体验分析都得到了IBM客户的极大关注。

相关资讯

- IBM实现了创纪录的深度学习性能:完败Facebook微软

- IBM 深度学习模式效率惊人, 一举超越 Facebook 和微软

- 巴菲特售出大量IBM股票:罗睿兰并不担心

- 美国总统找微软/苹果/Intel/谷歌/IBM等大佬憋大招: 为这事

- 其他入选榜单的科技公司还有微软 IBM Facebook 英特尔 甲骨文 思科和台积电

- 人工智能发展风起云涌, 这家被微软看中的公司却领先各大巨头

- Rimini Street扩大技术平台覆盖范围,为IBM、微软和SAP (Sybase)数据库提供支持服务

- IBM与三星联合打造超微芯片:性能大幅提升

- IBM推全球首个5纳米芯片:计划2020年量产

- IBM攻克5nm晶体管难题:手机续航提升3倍